Sam 18 oct | 19h > 22h

Tous les étudiants de 1ère année de l’ENSAPC (promotion 2013-2014)

A11 314

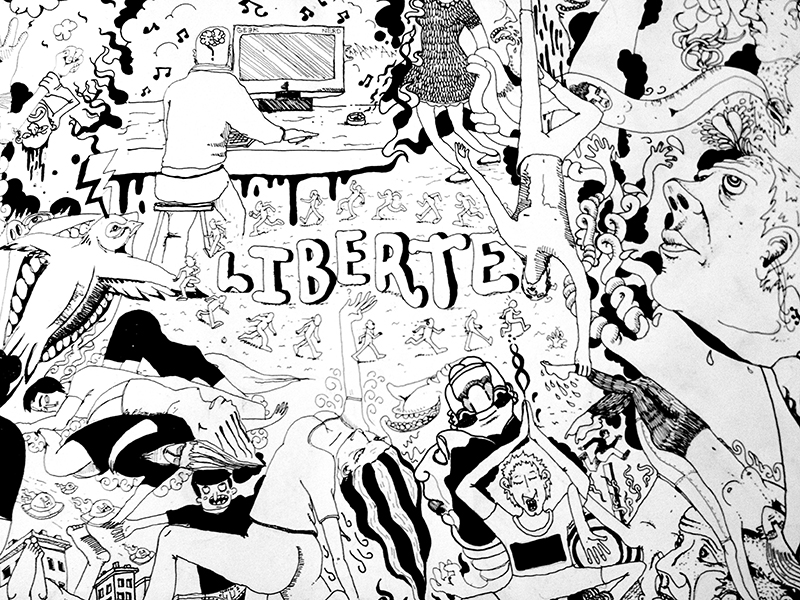

PERFORMANCE INTERACTIVE / CRÉATION SONORE / LUMIÈRE / VIDÉO / DESSIN

Jake, enseignante à l’ENSAPC (Direction projet de recherche A11), Pascale Péladan (Chorégraphie), Nicolas Rasamimanana (Phonotonic) A11 314 a été créé à l’ENSAPC au cours d’un workshop en mars 2014 réunissant tous les 47 étudiants de la 1ère année de l’ENSAPC . A11 314 a pour thème la LIBERTÉ (insaisissable en soi) et porte sur les trajectoires du groupe d’interprètes. Un groupe de jeunes artistes échange, croise et arrête leur regard tout en exécutant des mouvements partiellement synchronisés avec des projections lumineuses. Cette pièce chorégraphique se crée en direct grâce à des capteurs de mouvement relevant des technologies de l’interaction du geste et du son. En temps réel, le rythme, la tonalité et la vélocité des écritures musicales vont sans arrêt se modifier. Figures géométriques, formes sculpturales, les corps se trouvent par intermittence recouverts de lumière digitale.

En partenariat avec l’ENSAPC, l’École Nationale Supérieure d’Arts de Paris Cergy.

Projet de recherche A11 – Interaction Son Musique Mouvement (2010-2015) A11 est un programme de recherche de cinq ans, conçu en 2010 par Jake, artiste et enseignante à l’ENSAPC, en collaboration avec Nicolas Rasamimanana, fondateur de Phonotonic. Le 1er axe du projet de A11 répond à un intérêt grandissant des étudiants de l’ENSAPC pour les performances à caractère interdisciplinaire qui intègrent la synchronisation, l’interaction entre le mouvement des interprètes, divers processus sonores ou visuels, et d’autres champs artistiques. A11 exploite les systèmes musicaux interactifs portant sur le contrôle gestuel et sur l’analyse et la reconnaissance du mouvement, nouvelles technologies développées par l’IRCAM et Phonotonic. A11 utilise ainsi un outil intitulé « suivi de geste », qui permet la reconnaissance précise d’éléments gestuels définis par les performeurs. Ces caractéristiques temporelles sont saisies par des capteurs fixés sur le corps des participants. Les systèmes précités ont été expérimentés dans les performances afin d’obtenir une synchronisation et une interaction entre le mouvement et les processus sonores et visuels. Le 2ème axe de recherche porte sur la dimension pédagogique, soit l’apprentissage collectif en direction de jeunes artistes de technologies de pointe. Les étudiants de 1ère année expérimentent ici un travail en groupe et apprennent à maîtriser des technologies nouvelles, telles que l’informatique et la modélisation du son et du geste en temps réel ainsi que l’interaction entre homme et machine.